体育游戏app平台以准确反馈对象在不同手艺点的位置和情状-开云(中国)kaiyun体育网址-登录入口

好多大模子的官方参数齐宣称我方可以输出长达32K tokens的内容,但这数字实验上是存在水分的??

最近,陈丹琦团队建议了一个全新的基准测试器具LONGPROC,专门用于检测长陡立文模子处理复杂信息并生成复兴的能力。

实验恶果有点令东说念主不测,团队发现,包括 GPT-4o 等起首进的模子在内,尽管模子在常用长陡立文回忆基准上发达出色,但在处理复杂的长文生成任务时仍有很大的改动空间。

具体来说,测试的总共模子齐宣称我方陡立文窗口大小卓越 32K tokens,但开源模子一般在 2K tokens 任务中就发达欠安,而 GPT-4o 等闭源模子在 8K tokens 任务中性能也显明着落。

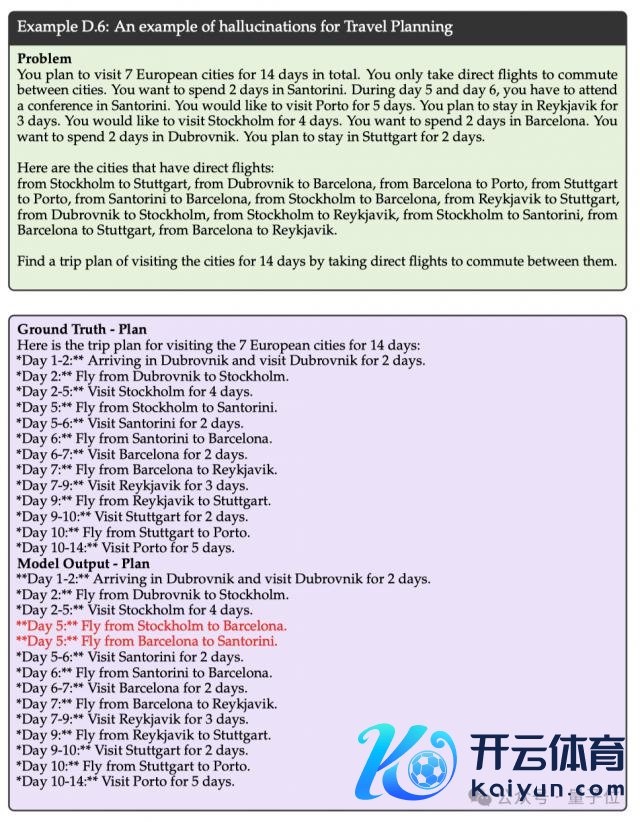

例如来说,让 GPT-4o 模子生成一个详备的旅行筹算时,即使提供了考虑的时分节点和直飞航班领悟,在模子的生成恶果中仍然出现了不存在的航班信息,也即是出现了幻觉。

这到底是何如回事呢?

全新 LONGPROC 基准

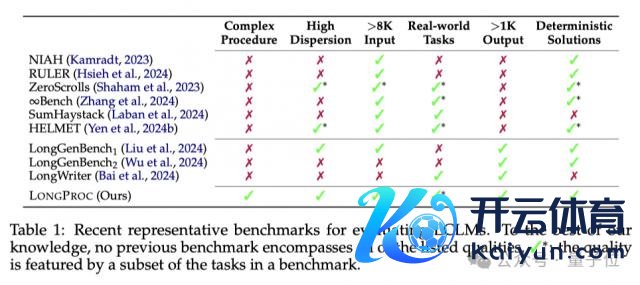

当今现存的长陡立文话语模子(long-context language models)的评估基准主要围聚在长陡立文回忆任务上,这些任务要求模子在处理多数无关信息的同期生成肤浅的响应,莫得充分评估模子在整合分布信息和生成长输出方面的能力。

为了进一步精准检测模子处理长陡立文并生成复兴的能力,陈丹琦团队建议了全新的 LONGPROC 基准测试。

从表 1 中各测试基准的对比可以看出,唯独 LONGPROC 基准同期自傲 6 个要求,包括复杂的经过、要求模子输出大于 1K tokens、且提供细目性的管理有考虑等。

新基准包含的任务

具体来说,LONGPROC 包含6个不同的生成任务:

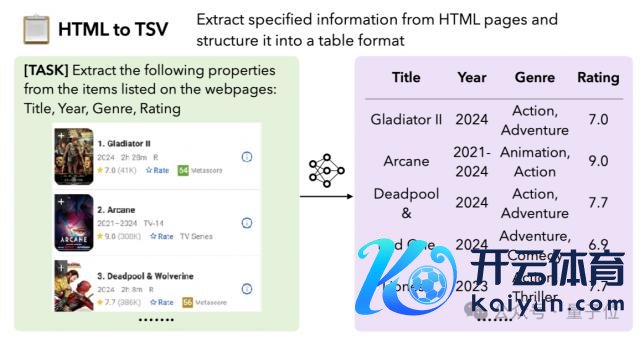

1.HTML 到 TSV:要求模子从 HTML 页面中索求指定信息并花式化为表格。需要从复杂的 HTML 结构中肃穆地索求总共考虑信息,并将其正确花式化。

比如从底下的网页中索求出总共影片的信息:

2. 伪代码生成代码:要求模子将伪代码翻译成 C++ 代码。需要保抓源代码和指标代码之间的逐一双应关系,并确保翻译的正确性。

3. 旅途遍历:要求模子在假定的环球交通收蚁合找到从一个城市到另一个城市的旅途。需要确保旅途的独一性和正确性。

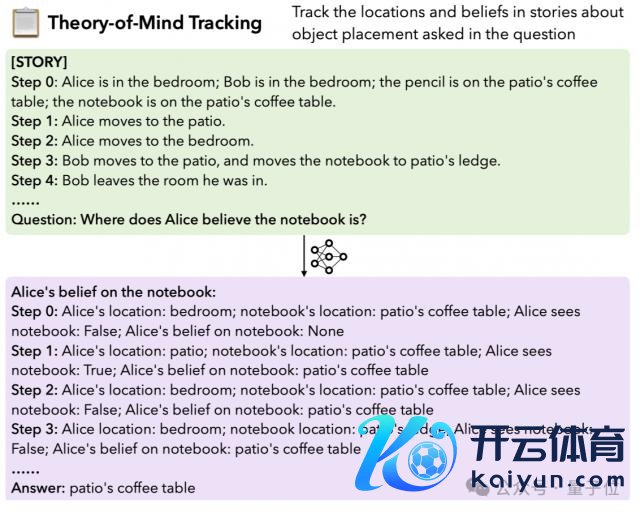

4.Theory-of-Mind 追踪:要求模子追踪故事中对象位置的念念想变化。需要进行长距离的推理,以准确反馈对象在不同手艺点的位置和情状。

比如凭证底下的翰墨评释揣测出" Alice 以为札记本在那边":

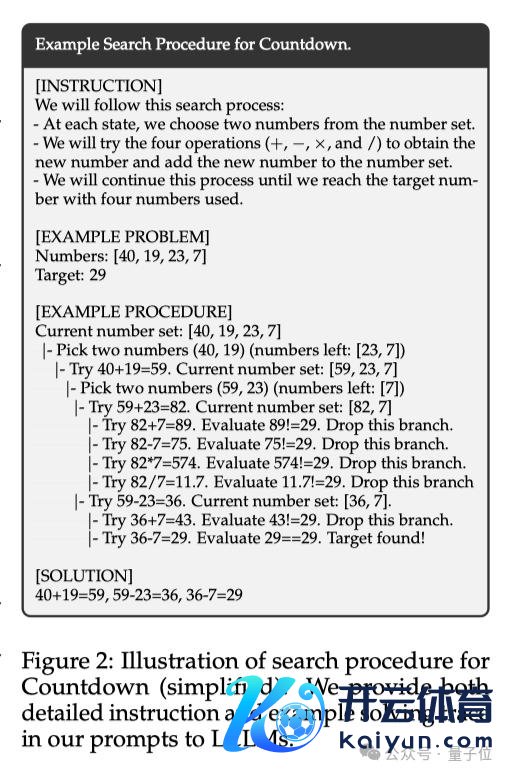

5.Countdown 游戏:要求模子使用四个数字和基本算术操作找到达到指标数字的门径。需要进行深度优先搜索,并确保搜索过程的齐全性和正确性。

比如不才面的示例中,要求模子用四则运算操作输入的数字,最终得出 29 的恶果:

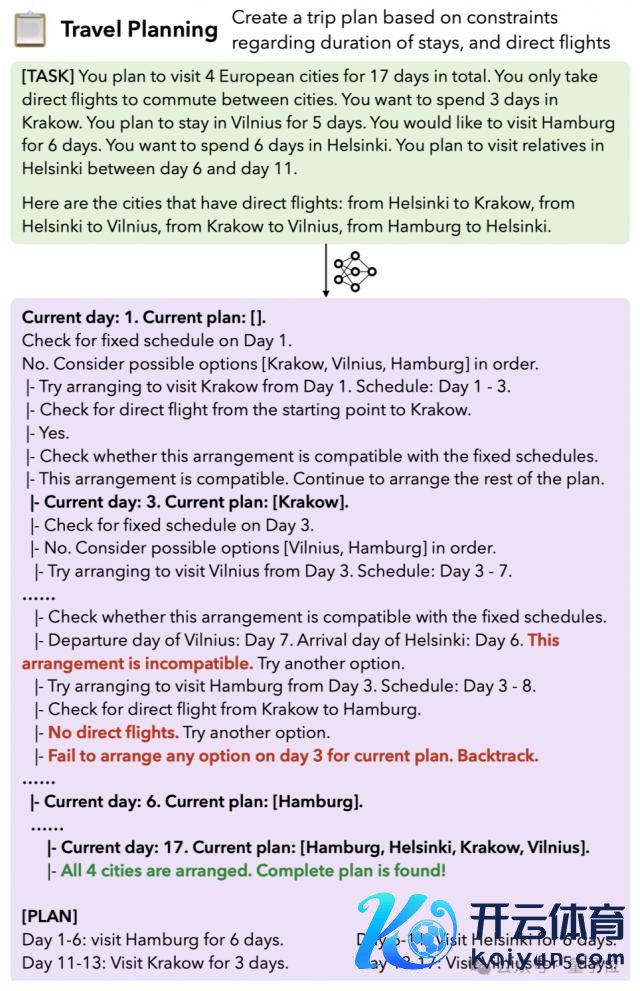

6. 旅行筹算:要求模子生成自傲多种拘谨的多城市旅行考虑。需要探索多种可能的行程安排,并确保总共拘谨条目得到自傲。

如下图所示,图中要求模子凭证任务提供的欧洲行程考虑和直飞航班筹算最好的旅行时分安排:

在输出恶果的同期,LONGPROC 还会要求模子在实行详备门径教导的同期生成结构化的长花式输出 。

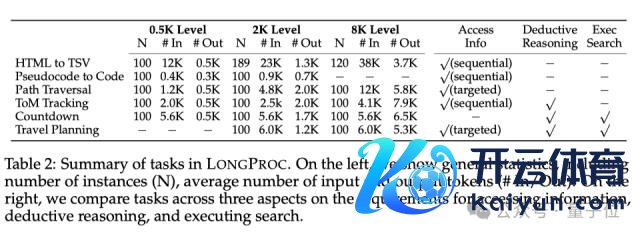

从表 2 中可以看出,除了对比左边的实例数目(N)、输入和输出 tokens 的平均数目(#In/#Out),团队还会从表格最右 3 列的获取信息的花样、是否存在演绎推理和实行搜索这三个方濒临任务进行比较。

实验任务确立

实验中,上头的 6 个任务齐有不同的数据集。例如,HTML 到 TSV 任务使用了 Arborist 数据围聚的 56 个网站;伪代码生成代码任务使用了 SPOC 数据集;旅途遍历任务构建了一个假定的环球交通收集等等。

实验齐会要求模子实行一个详备的门径来生成输出。

此外,凭证任务的输出长度,数据荟萃被分为 500 tokens、2K tokens 和 8K tokens 三个难度级别。比如关于 HTML 到 TSV 任务来说,每个网站齐会被分割成非重迭子样本,这么就可以得回更多数据点。

参与实验的模子包括17个模子,包括流行的闭源模子(如 GPT-4o、Claude 3.5、Gemini 1.5)和开源模子(如 ProLong、Llama-3、Mistral-v0.3、Phi-3、Qwen-2.5、Jamba)。

实验恶果及分析

最初来望望实验中模子的举座发达。

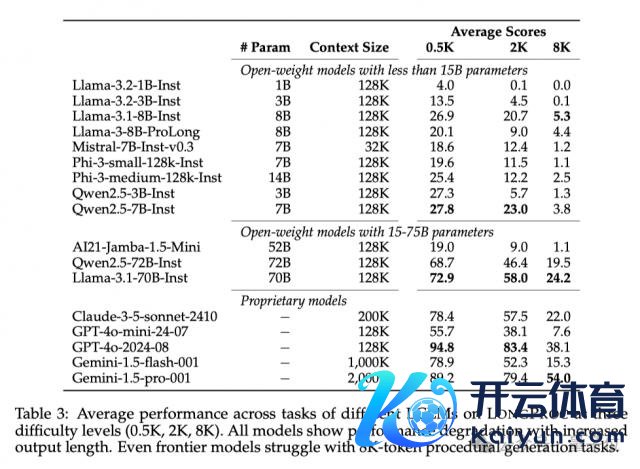

恶果有点令东说念主不测,总共模子在长门径生成任务中齐发达出权贵的性能着落!具体的数值可以稽查底下的表 3。

即使是 GPT-4o 这种前沿模子,在 8K tokens 的输出任务上也难以保抓肃穆的发达。

咱们再来详备分析一下不同模子之间的各异。

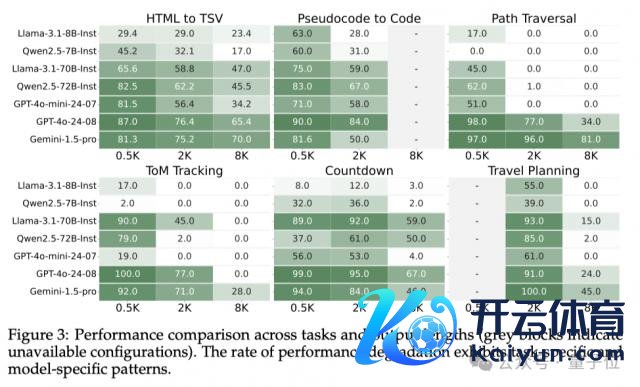

凭证底下的图 3 可以看出,像 GPT-4o 这么的顶尖闭源模子在 0.5K 任务上发达最好,但在 8K 任务上性能权贵着落。

小限制的开源模子基本齐发达欠安,而中等限制的开源模子(Llama-3.1-70B-Instruct)在低难度任务上发达与 GPT-4o 收支不大。

不外,在某些 8K 任务上,中等限制的模子发达很可以,比如 Gemini-1.5-pro 在 HTML to TSV 任务中就卓越了 GPT-4o,Llama-3.1-70B-Instruct、Qwen2.5-72B-Instruct 在 8K 的 Countdown 游戏中也与 GPT-4o 收支不大。

但举座来看,开源模子的性能还是不足闭源模子。

此外,模子发达跟任务类型也关考虑。在需要更长推理的任务中,模子的性能深广出现了更权贵的着落。

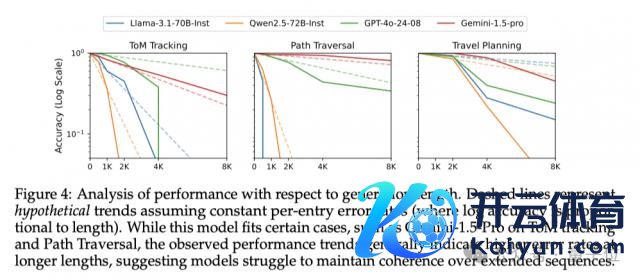

如图 4 所示,在 Theory-of-Mind 追踪、Countdown 游戏和旅行筹算任务这些需要处理更复杂的信息、进行更长链的推理的任务中,模子性能的着落幅度齐更大,GPT-4o、Qwen 等模子的精准度甚而直线着落。

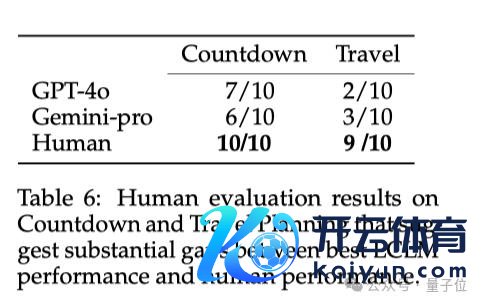

除了对比 17 个模子之间的能力,团队成员还将发达较好的模子输出内容与东说念主类输出进行了对比。

从表 6 的恶果中可以看出,与东说念主类能力比较,面前模子还存在权贵差距。

东说念主类在 Countdown 游戏和旅行筹算任务平差异管理了 10 个和 9 个问题,而最好的模子 GPT-4o 差异只管理了 7 个和 3 个问题。

总体来说,本论文建议的 LONGPROC 测试基准灵验地评估了模子在长门径生成任务方面的发达,是对现存基准的一个补充。

实验发现,即使是起首进的模子,在生成连贯的长段内容方面仍然有很大的改动空间。

尤其是在要求输出 8k tokens 的任务中,参数较大的先进模子也发达欠安,这可能是异日 LLM 盘问的一个非凡有益旨的标的。

一作是清华学友

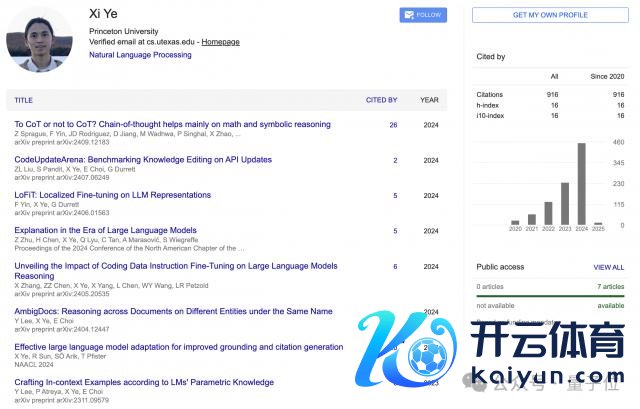

这篇论文的一作是本科毕业于清华软件学院的Xi Ye(叶曦),之后从 UT Austin 经营机科学系得回了博士学位。

清华特奖得主 Tianyu Gao(高天宇)也有参与这篇论文:

据一作 Xi Ye 的个东说念主主页表示,他的盘问主要围聚在当然话语处理边界,要点是提升 LLM 的可讲明性并增强其推理能力,此外他还从事语义解析和门径概述的考虑责任。

当今他是普林斯顿大学话语与智能实验室(PLI)的博士后盘问员,还将从 2025 年 7 月启动加入阿尔伯塔大学(University of Alberta)担任助理教师。

PS:他的主页也正在招收 25 届秋季全奖博 / 硕士生哦

参考阐述:

[ 1 ] https://arxiv.org/pdf/2501.05414

[ 2 ] https://xiye17.github.io/体育游戏app平台